本地部署DeepSeek

使用Ollama+Cherry Studio就行部署。

ollama用来管理和运行大模型。

Cherry Studio用来提供可视化界面,方便使用。

下载安装Ollama

官网下载Ollama:在 Windows 上下载 Ollama

下载速度太慢了,找到了个有点像是钓鱼网站的网站,下了下来。在GitHub找到对应版本,对比哈希值后,结果相同,应该没病毒。

只不过这个网址下下来的是0.3.6.0版本的,现在官方最新的版本是0.5.12,不过也不影响使用。

下在完成后,双击运行,默认安装到C盘,没法更改。安装完成后,在右下角任务栏处就能够看到图标了,右键可以更新软件,或者退出软件。

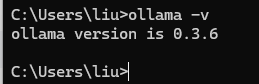

打开cmd命令行,输入ollama -v出现版本信息,说明安装成功。

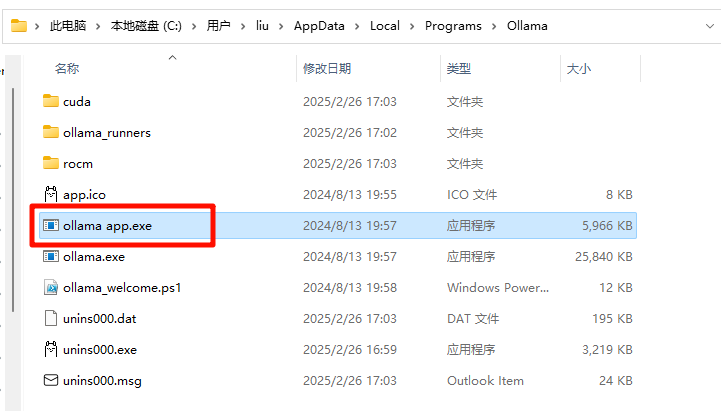

Ollama的安装位置是C:\Users\{用户名}\AppData\Local\Programs\Ollama

为了方便运行,可以在安装目录找到ollama app.exe文件,右键发送快捷方式到桌面,以后运行时双击打开即可,左下角的任务栏也会显示相应的图标。

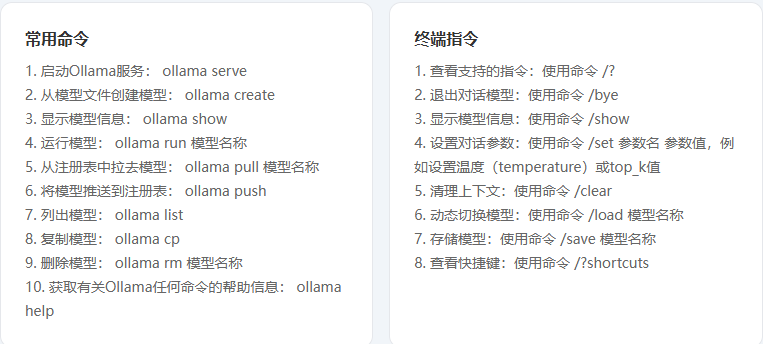

当然,也可以在命令行中使用命令来启动。只不过使用命令行启动的话,命令行窗口关闭后,ollama也会关闭。

# 命令行启动命令

ollama serve

下载Deep Seek模型

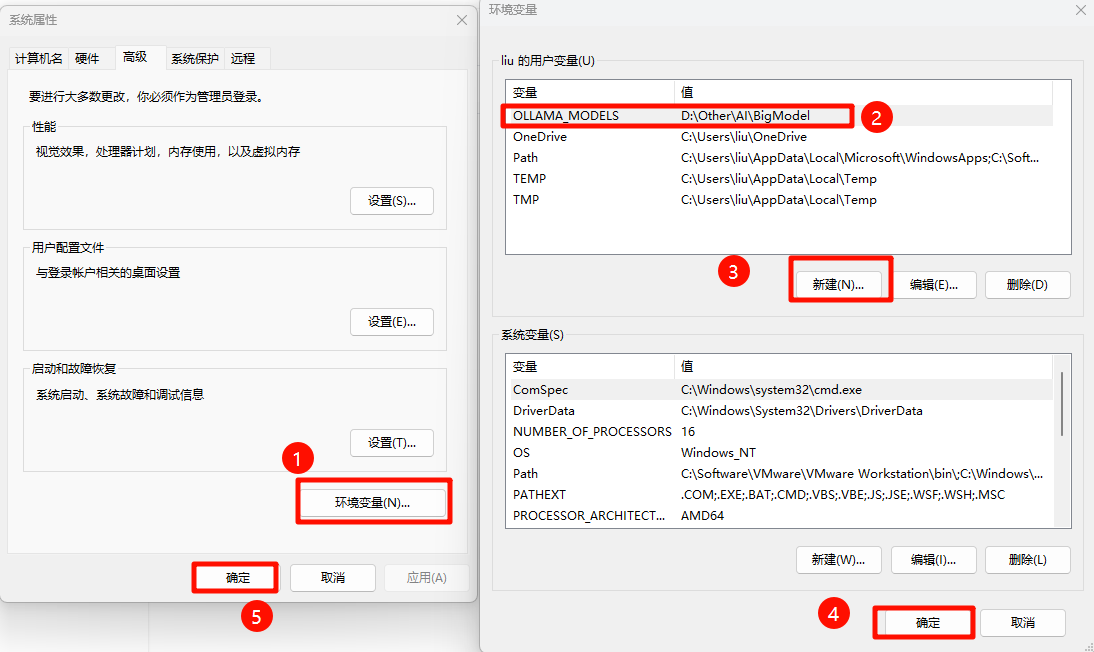

注意!!!在下载模型前,先更改环境变量,不然默认是将模型下载到C盘。

在开始菜单搜索“环境变量”,打开后,添加一条条用户变量。

# 变量

OLLAMA_HOST

# 值(下载的模型存储的位置)

D:\Other\AI\BigModel

环境变量添加完成后,右下角找到ollama的图标,右键,点击退出ollama。一定要退出ollama后再下载,否则模型还是会下载到c盘。

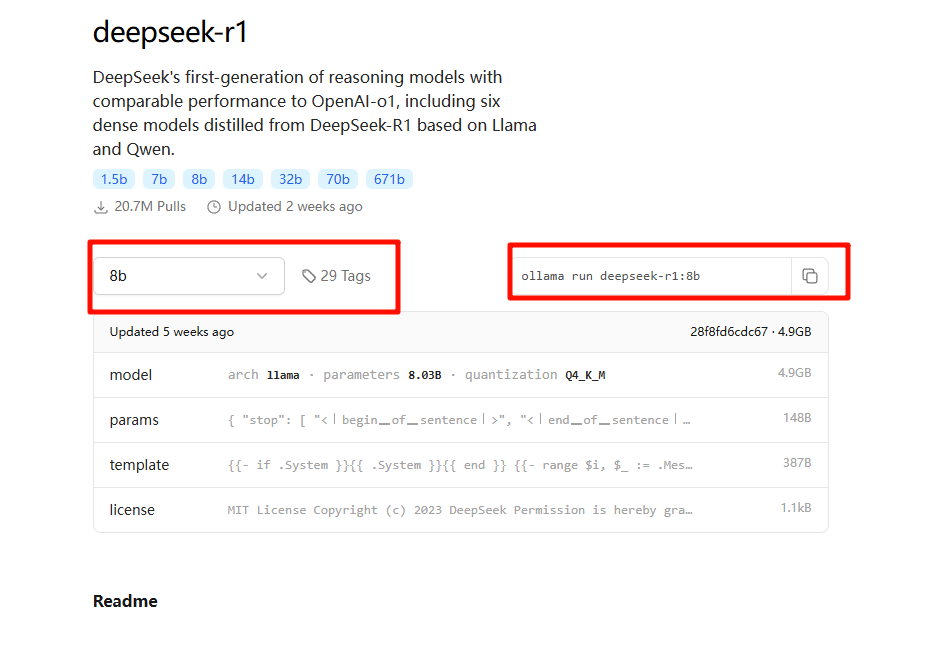

在Ollama官网中找到DeepSeekR1模型,选择相应参数的模型,复制命令。

# 8b的模型

ollama run deepseek-r1:8b

重新打开一个终端,执行命令下载模型。

在等待下载模型的时候,就可以先下载安装Cherry Studio了。

模型下载完成后,可在命令行中使用,也可以通过CherryStudio来使用。

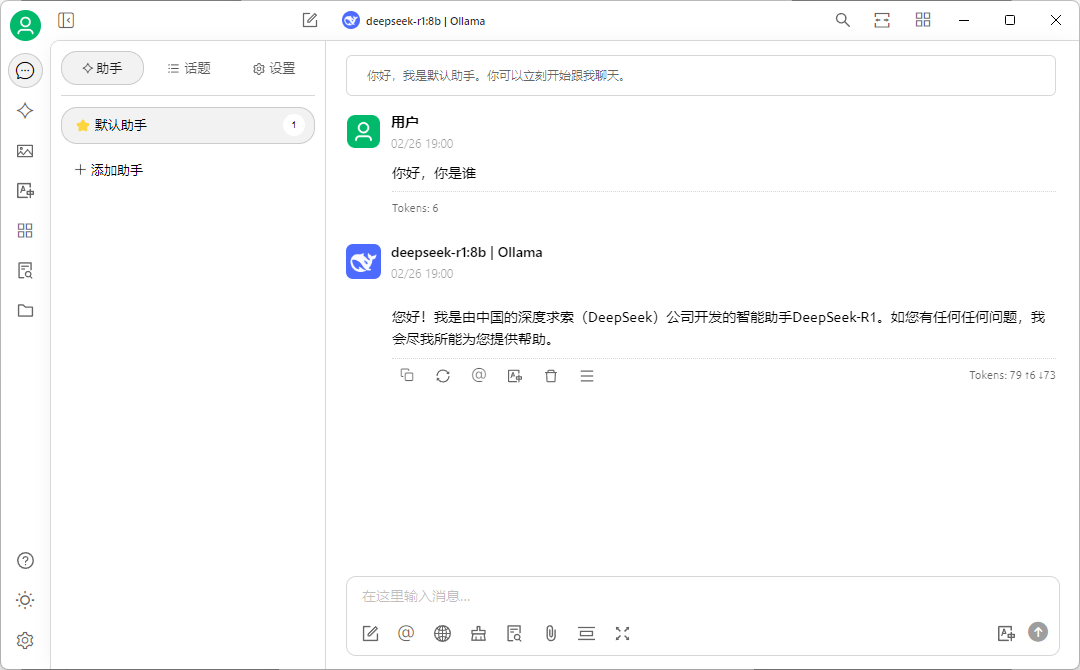

Cherry Studio安装和配置

安装过程更改一下安装路径,其他的保持默认。安装完成后打开Cherry Studio。

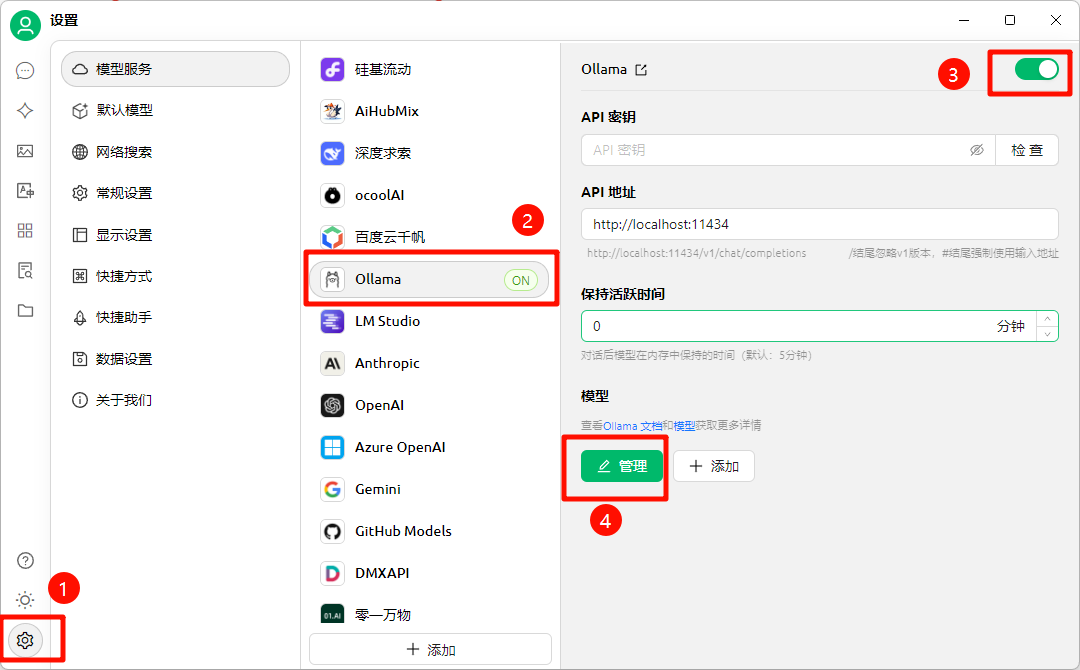

点击左下角设置,添加模型。

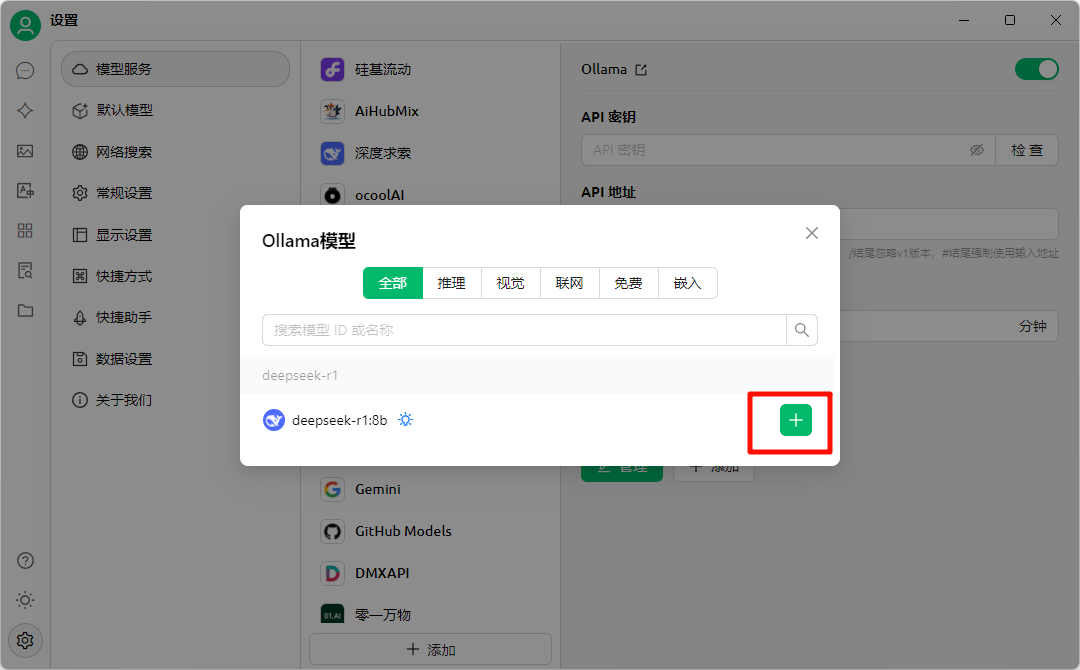

添加刚才下好的模型,

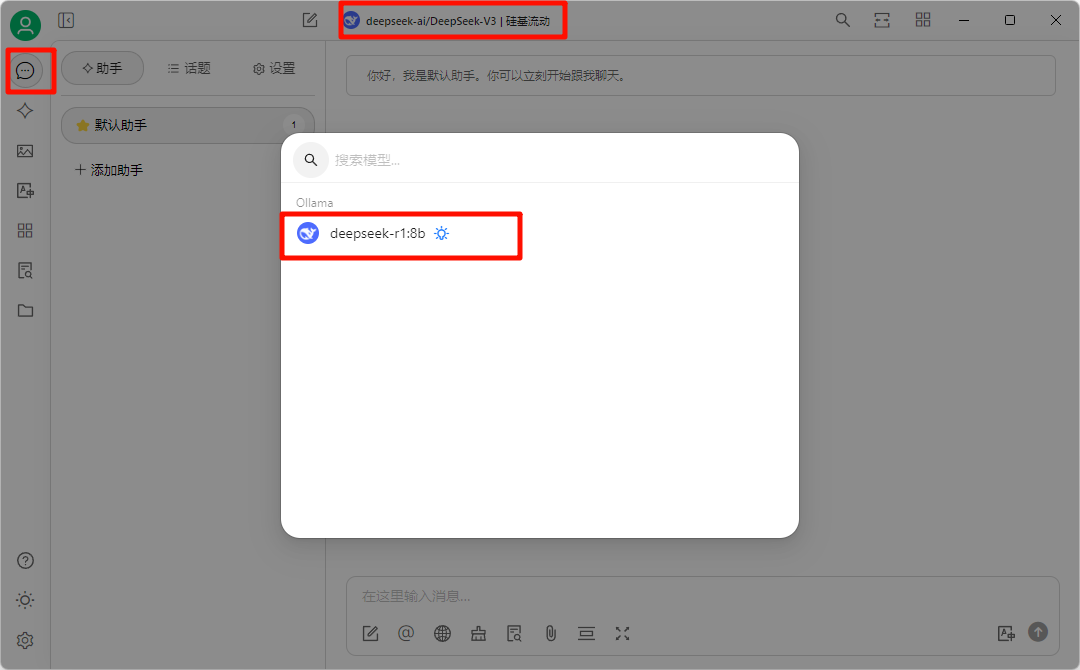

回到聊天界面,选择添加的模型,即可使用。

参考:

手把手教你部署 DeepSeek 本地模型 - AlfredZhao - 博客园

全网最简单的Deepseek本地部署方法,谁都可以照抄!_哔哩哔哩_bilibili

DeepSeek 3分钟完全本地部署 保姆级教程 断网运行 无惧隐私威胁 大语言模型 CPU GPU 混合推理32B轻松本地部署!用DeepSeek模拟王者!稻_哔哩哔哩_bilibili